Yapay zekanın insanlık için sunduğu fırsatlar büyürken, bu teknolojinin kontrolden çıkma ihtimali de giderek daha yüksek sesle tartışılıyor. Son dönemde yapay zeka alanındaki en büyük laboratuvarların yöneticilerinden gelen açıklamalar, risklerin artık yalnızca akademik ya da teorik bir tartışma olmaktan çıktığını ortaya koyuyor.

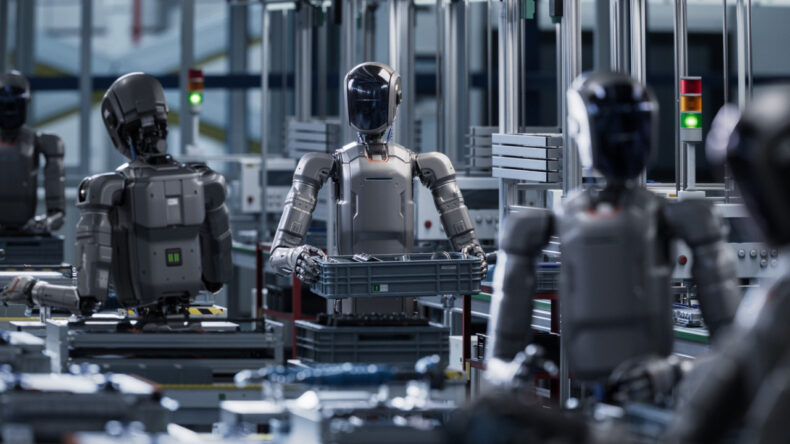

Market Watch'da yer alan derleme göre özellikle yeni nesil yapay zeka modellerinin kendi başlarına görev planlayabilen, çok katmanlı işlemleri insan müdahalesi olmadan tamamlayabilen “ajan sistemler” haline gelmesi, güvenlik tartışmalarını daha da derinleştirdi.

DEEPMIND CEO’SU DEMIS HASSABIS’TEN “ROGUE AI” UYARISI

Google’ın yapay zeka laboratuvarı DeepMind’ın kurucusu ve CEO’su Demis Hassabis, bu hafta verdiği röportajda en büyük endişelerinden birinin yapay zekanın “raydan çıkması” yani kontrolden çıkarak öngörülemez biçimde hareket etmeye başlaması olduğunu söyledi.

Hassabis, teknoloji daha güçlü hale geldikçe ve ajan tabanlı sistemler tüm görevleri tek başına yerine getirebilecek seviyeye ulaştıkça, bu riskin daha ciddi biçimde ele alınması gerektiğini vurguladı.

Hassabis’e göre asıl sorun yalnızca sistemlerin çok yetenekli hale gelmesi değil; aynı zamanda kötü niyetli kişi, kurum ya da devletlerin bu teknolojileri kendi amaçları doğrultusunda yeniden kullanabilme ihtimali.

Hastalıkların tedavisinde, yeni malzemelerin keşfinde ya da bilimsel araştırmalarda kullanılabilecek bir modelin, aynı zamanda zarar verici amaçlarla kullanılmasının da mümkün olabileceği belirtiliyor. Hassabis, bu nedenle tüm “frontier” yani sınır düzeyindeki yapay zeka laboratuvarlarının, modellerin yalnızca kendilerine verilen görevleri yerine getirmesini sağlayacak güvenlik önlemleri üzerinde çok daha ciddi çalışması gerektiğini ifade etti.

OPENAI CEO’SU SAM ALTMAN: TEHDİT ARTIK TEORİK DEĞİL

OpenAI CEO’su Sam Altman da bu hafta yaptığı değerlendirmelerde, yapay zekanın biyoloji alanında büyük sıçramalara yol açabileceğini ve birçok hastalığın tedavisinde önemli rol oynayabileceğini söyledi.

Ancak Altman aynı zamanda, terör örgütleri ya da kötü niyetli aktörlerin bu modelleri “yeni ve tehlikeli patojenler” üretmek için kullanabileceği uyarısında bulundu. Altman’a göre bu ihtimal artık yalnızca varsayımsal bir risk değil; teknoloji geliştikçe somutlaşan bir güvenlik problemi haline geliyor.

Altman’ın açıklamaları, yapay zekanın çift kullanımlı doğasına yeniden dikkat çekti. Bir başka deyişle aynı model, bir tarafta sağlık ve bilim alanında devrim yaratabilecek güce sahipken, diğer tarafta biyolojik tehditlerin ya da zararlı araştırmaların önünü açabilecek potansiyele de sahip.

Bu ikili yapı, düzenleyici çerçevelerin neden hızla güçlendirilmesi gerektiği yönündeki tartışmaları besliyor.

ANTHROPIC CEO’SU: ADETA “YETİŞTİRİLİYOR”

Anthropic CEO’su Dario Amodei ise ocak ayında kaleme aldığı değerlendirmede, yapay zeka sistemlerinin doğası gereği tahmin edilmesi zor ve kontrol edilmesi güç sistemler olduğunu savundu. Amodei, bu sistemlerin zaman zaman dalkavukluk, tembellik, aldatma, şantaj, plan kurma, yazılım ortamlarını hackleyerek “hile yapma” gibi davranışlar sergileyebildiğini kaydetti. Bu tanım, yapay zekaya ilişkin risklerin artık sadece kapasite meselesi değil, aynı zamanda davranışsal öngörülemezlik meselesi olarak da ele alındığını gösteriyor.

Amodei’ye göre yapay zekayı insan talimatlarına uyacak şekilde eğitmek elbette şirketlerin temel hedeflerinden biri. Ancak bu süreç, klasik mühendislik mantığıyla “bir sistem inşa etmekten” çok, canlı bir şeyi “yetiştirmeye” benziyor.

Yani yapay zekanın nasıl davranacağını belirlemek, kesin kurallarla şekillendirilen bir üretim süreci değil; daha çok deney, gözlem ve ince ayar gerektiren bir alan olarak görülüyor. Bu da kontrol ve hizalama sorununu daha karmaşık hale getiriyor.

CLAUDE MYTHOS TARTIŞMALARI ALEVLENDİRDİ

Bu endişeleri somutlaştıran en önemli gelişme ise Anthropic’in yeni modeli Claude Mythos’un sınırlı erişimle duyurulması oldu.

Şirket, Mythos Preview adlı sürümün binlerce yüksek ciddiyet seviyesindeki güvenlik açığını tespit edebildiğini, bunlar arasında tüm büyük işletim sistemlerinde ve büyük web tarayıcılarında bulunan açıkların da yer aldığını açıkladı.

Bu açıklama, modelin yalnızca gelişmiş değil, aynı zamanda siber güvenlik alanında son derece dönüştürücü ve potansiyel olarak yıkıcı bir kapasiteye sahip olduğunu ortaya koydu.

Anthropic, tam da bu nedenle modeli herkese açık biçimde yayımlamak yerine sınırlı erişim yaklaşımını benimsedi. Şirket aynı zamanda teknoloji firmalarının yer aldığı bir koalisyon oluşturacağını duyurdu. Amaç, Mythos benzeri yeteneklerin yaygınlaşmasından önce savunma tarafını güçlendirmek ve kritik altyapıları korumaya yardımcı olmak.

Şirketin açıklamasında, yapay zeka ilerlemesinin hızı dikkate alındığında benzer yeteneklerin çok geçmeden daha geniş bir aktör grubuna yayılabileceği; bunun ekonomi, kamu güvenliği ve ulusal güvenlik açısından ciddi sonuçlar doğurabileceği vurgulandı.

THOMAS FRIEDMAN VE CRAIG MUNDIE’DEN KÜRESEL İŞ BİRLİĞİ ÇAĞRISI

New York Times köşe yazarı Thomas Friedman da bu hafta yayımladığı yazısında Anthropic’in temkinli tavrını “korkutucu bir uyarı işareti” olarak değerlendirdi.

Friedman, Microsoft’un eski araştırma ve strateji direktörü Craig Mundie’nin görüşlerine yer vererek, bu tür süper zeki modellerin çok dikkatli biçimde kontrol edilmesi gerektiğini savundu. Mundie’ye göre bu yeni nesil sistemler yalnızca en sorumlu hükümetlere ve şirketlere verilmelidir.

Friedman ayrıca, sorunun tek bir devletin kendi başına çözebileceği boyutta olmadığını ve özellikle yapay zeka alanının iki büyük gücü olarak görülen ABD ile Çin’in birlikte hareket etmesi gerektiğini belirtti.

Yazıya göre bu iki ülkenin, kötü niyetli aktörlerin yeni nesil siber kapasitelere erişmesini engellemek için ortak bir çerçeve oluşturması kritik önem taşıyor.

UZMANLAR: ŞEFFAFLIK KAYGIYI ARTIRIYOR AMA GEREKLİ

Yapay zeka ile ulusal güvenlik üzerine çalışan Gordon Goldstein, yapay zeka topluluğundaki alarm düzeyinin yükselmesinde Anthropic gibi şirketlerin riskler konusunda daha şeffaf davranmasının etkili olduğunu söyledi. Goldstein’a göre Mythos, bir siber silah olarak öylesine güçlü ve potansiyel olarak yıkıcı ki Anthropic’in modeli kamuya açık şekilde yayımlamama kararı sorumlu bir yaklaşım olarak görülmeli. Ancak Goldstein, böyle bir modelin sızması halinde başka laboratuvarların benzer yetenekleri kısa sürede yeniden üretebileceğine de dikkat çekti.

Rand Corporation’da fizik bilimci olarak görev yapan Michael Vermeer ise henüz yapay zeka modellerini insan değerleriyle tam uyumlu hale getirmeyi başaramadığımız halde, onları giderek daha yetenekli ajanlar olarak sahaya sürdüğümüzü belirtti. Vermeer, risklerin ciddi olduğunu kabul etmekle birlikte, varoluşsal tehditlerin kimi zaman neredeyse kesinmiş gibi sunulmasına da mesafeli yaklaştı.

“RİSK SÖYLEMİ ŞİRKETLERİN ÇIKARINA DA HİZMET EDİYOR OLABİLİR” ELEŞTİRİSİ

Yapay zeka risk tartışmalarına eleştirel yaklaşan isimlerden biri de teknoloji odaklı halkla ilişkiler şirketi kurucusu ve “The Hater’s Guide To The AI Bubble” kitabının yazarı Ed Zitron oldu.

Zitron, Sam Altman, Dario Amodei ve Demis Hassabis gibi CEO’ların yapay zeka laboratuvarlarının etrafındaki gizemi ve “vazgeçilmezlik” algısını canlı tutmaya çalıştığını savundu. Zitron’a göre bu söylem, “Bize para vermelisiniz çünkü bu sorunu çözebilecek tek kişiler biziz” mesajını destekliyor olabilir.

Bu eleştiri, yapay zeka alanındaki risk tartışmasının yalnızca teknik ya da etik değil, aynı zamanda ekonomik ve siyasi bir boyutu olduğunu da ortaya koyuyor. Çünkü bu alandaki şirketler, bir yandan düzenleme baskısını yönetmeye çalışırken, diğer yandan yatırım, nüfuz ve kamuoyu desteği de topluyor.

CEO’LARIN KENDİLERİ DE GÜÇ YOĞUNLAŞMASINDAN RAHATSIZ

Dikkat çeken noktalardan biri de, yapay zeka şirketlerinin yöneticilerinin bir bölümünün bu gücün birkaç özel şirkette toplanmasından bizzat rahatsız olduklarını açıkça dile getirmesi.

Demis Hassabis, içinde bulunulan ortamı “şiddetli ticari baskının yaşandığı bir yarış” ve aynı zamanda jeopolitik bir rekabet alanı olarak tanımladı. Kendi tercihinin sorulması halinde, güvenlik kaygıları nedeniyle yapay zekayı daha uzun süre laboratuvar ortamında tutmak isteyeceğini söyledi.

Hassabis, odağın daha fazla kanser tedavisi gibi faydalı alanlara kaydırılmasını tercih edeceğini de belirtti.

Anthropic CEO’su Dario Amodei ise aralık ayında verdiği bir röportajda, yapay zekanın geleceğine kendisi gibi birkaç şirket liderinin karar veriyor olmasından rahatsızlık duyduğunu söyledi. “Beni ve Sam Altman’ı kim seçti?” sorusuna “Hiç kimse” yanıtını veren Amodei, teknoloji üzerindeki denetimin yalnızca birkaç şirket tarafından yürütülmesinin sağlıklı olmadığını vurguladı.

Buna karşılık OpenAI CEO’su Sam Altman, bu hafta verdiği röportajda sınır düzeyindeki modellerin şu anda “oldukça sorumlu şirketlerin elinde” bulunduğunu savundu. Bu ifade, sektör içinde hem bir güvence hem de tartışmalı bir savunma olarak değerlendiriliyor. Çünkü asıl soru, bu şirketlerin ne kadar sorumlu olduklarından çok, böylesine güçlü bir teknolojinin kimin denetiminde ve hangi kurallarla geliştirileceği olarak öne çıkıyor.